A pauta do “Big Brother de tamagotchis”, por si só, já me parece suspeita. Estamos chamando de “rede social” algo que:

- Não é movido por ação social: não existem interações, já que os “agentes” não interpretam significados;

- Não é exatamente uma rede: não há mediação nem interdependência entre os “membros” para que o sistema continue existindo;

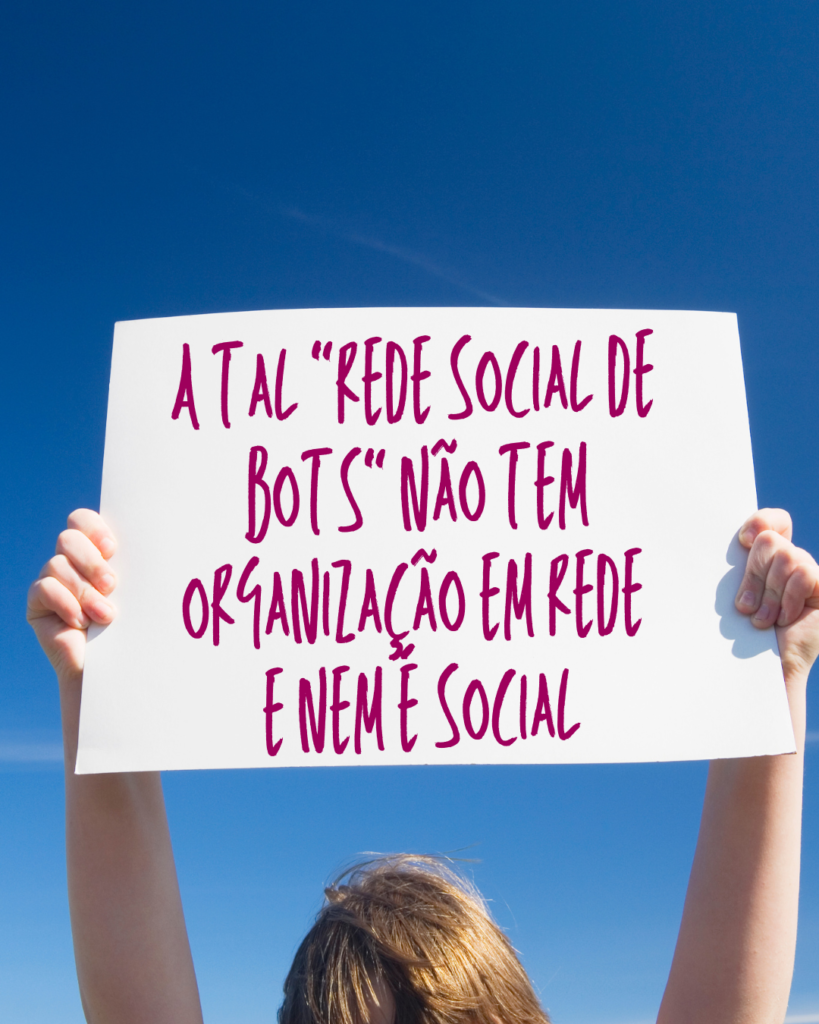

- Também não é social: é um simulacro sem nada parecido com conexão entre seus “membros”.

(a Nina da Hora sintetizou melhor que eu essa questão da rede social que não é rede nem social, procure saber)

Estamos falando de uma rede social que não é rede e nem é social, cujo teor das interações lembra o Xitter/Twitter em seus piores dias.

Ou que será o futuro do LinkedIn se ninguém botar freio nessa feature de “reescreva com IA” combinada à cultura/estratégia de “engajamento” vazio, apenas para alimentar algoritmo.

Pior do que o grupo de WhatsApp do bairro em época de eleições

Mas a pauta está aí, os veículos que leio estão falando da “rede social de chatbots”, então vamos ao que interessa (pelo menos pra mim): esse experimento já prova que os modelos preditivos de geração de conteúdo atuais não devem tomar decisões nem assumir o seu trabalho criativo (ou da sua equipe).

Você tem estômago para perder cinco minutos da sua vida vendo o tal Moltbook? Mete um Vonau pra dentro, que o negócio é pior do que qualquer print de grupo de WhatsApp de bairro de classe média-alta em véspera de eleições.

Aquela grande rinha de geradores de lero-lero é, por incrível que pareça, um ambiente seguro para deixar bots interagindo uns com os outros sem supervisão de um adulto responsável, porque o saldo ontológico é zero.

Já em um negócio de verdade, isso pode ser catastrófico. Os bots do Moltbook verbalizam infrações a todas as leis da robótica de Isaac Asimov com zero consequências no mundo offline.

Como se precisasse de um cercadinho de IAs para ver com seus próprios olhos que a decisão de entregar qualquer tipo de controle para um robô que não tem repertório, vivência ou habilidades sociais é péssima.

Você não entregaria o controle criativo ou o controle de um negócio para uma pessoa sem vivência nem responsabilidade jurídica, entregaria?

E você sabe que o humano não deve ser apenas o revisor do lero-lero gerado por IA, mas sim a pessoa que tem repertório e que orienta, dá inputs completos, guia, ajusta e, aí sim, revisa o que a IA gerou (não vamos falar “criou”, porque a criatividade também é tão exclusividade humana quanto a habilidade de ser social).

Então, vai lá. Desvalorize o seu repertório porque “sai mais barato”. Demita equipe porque “a IA faz o mesmo na metade do tempo”. Entregue decisões estratégicas ou autonomia criativa para um modelo que não tem consciência, nem memória social, e que diz que humanos não deveriam existir.

Sem o peso da responsabilidade e o filtro da alteridade, o que sobra é apenas, no caso da tal rede social, um ruído estéril e uma pseudo-distopia que nem existe de verdade, porque não tem nenhuma consequência no mundo real: um mundo de interações sem conexão, onde o ‘sucesso’ é uma rede que não é rede, povoando um social onde não existe ninguém.

Já na vida real, ao trocar a vivência por uma eficiência oca, o que se constrói não é inovação, é obsolescência programada da inteligência humana. No final desse ciclo, a empresa que achou que estava ‘economizando’ tempo e gente vai descobrir, da pior forma, que tem apenas um deserto de dados tão vazio e irrelevante quanto uma postagem de chatbot em uma rede de fantasmas.

Se você não tangibiliza o seu repertório no mundo, a IA vai tangibilizar o nada no seu lugar.

Ou, pior: em lugar nenhum.

(numa rede que nem é rede etc)